【Kafka】Kafka 架构深入

Kafka工作流程及文件存储机制

Kafka 中消息是以topic进行分类的,生产者生产消息,消费者消费消息,都是面向 topic 的。

topic 是逻辑上的概念,而 partition 是物理上的概念,每个 partition 对应于一个 log 文件,该 log 文件中存储的就是 producer 生产的数据。Producer 生产的数据会被不断追加到该 log 文件末端,且每条数据都有自己的 offset。 消费者组中的每个消费者,都会实时记录自己消费到了哪个 offset,以便出错恢复时,从上次的位置继续消费。

由于生产者生产的消息会不断追加到 log 文件末尾,为防止 log 文件过大导致数据定位效率低下,Kafka 采取了分片和索引机制,将每个 partition 分为多个 segment。每个 segment 对应两个文件:“.index” 文件和 “.log” 文件。这些文件位于一个文件夹下,该文件夹的命名规则为:topic名称+分区序号。

例如,test 这个 topic 有三个分区, 则其对应的文件夹为 test-0、test-1、test-2。

index 和 log 文件以当前 segment 的第一条消息的 offset 命名

“.index” 文件存储大量的索引信息,“.log” 文件存储大量的数据,索引文件中的元数据指向对应数据文件中 message 的物理偏移地址

数据可靠性保证

为保证 producer 发送的数据,能可靠的发送到指定的 topic,topic 的每个 partition 收到 producer 发送的数据后, 都需要向 producer 发送 ack(acknowledgement 确认收到),如果 producer 收到 ack,就会进行下一轮的发送,否则重新发送数据。

数据一致性问题

LEO:指的是每个副本最大的 offset;

HW:指的是消费者能见到的最大的 offset,所有副本中最小的 LEO

1)follower 故障

follower 发生故障后会被临时踢出 ISR(Leader 维护的一个和 Leader 保持同步的 Follower 集合),待该 follower 恢复后,follower 会读取本地磁盘记录的上次的 HW,并将 log 文件高于 HW 的部分截取掉,从 HW 开始向 leader 进行同步。等该 follower 的 LEO 大于等于该 Partition 的 HW,即 follower 追上 leader 之后,就可以重新加入 ISR 了。

2)leader 故障

leader 发生故障之后,会从 ISR 中选出一个新的 leader, 之后,为保证多个副本之间的数据一致性,其余的 follower 会先将各自的 log 文件高于 HW 的部分截掉,然后从新的 leader 同步数据。

注:这只能保证副本之间的数据一致性,并不能保证数据不丢失或者不重复。

ack 应答机制

对于某些不太重要的数据,对数据的可靠性要求不是很高,能够容忍数据的少量丢失,所以没必要等 ISR 中的 follower 全部接收成功。所以 Kafka 为用户提供了三种可靠性级别,用户根据对可靠性和延迟的要求进行权衡选择。

当 producer 向 leader 发送数据时,可以通过 request.required.acks 参数来设置数据可靠性的级别:

●0:这意味着producer无需等待来自broker的确认而继续发送下一批消息。这种情况下数据传输效率最高,但是数据可靠性确是最低的。当broker故障时有可能丢失数据。

●1(默认配置):这意味着producer在ISR中的leader已成功收到的数据并得到确认后发送下一条message。如果在follower同步成功之前leader故障,那么将会丢失数据。

●-1(或者是all):producer需要等待ISR中的所有follower都确认接收到数据后才算一次发送完成,可靠性最高。但是如果在 follower 同步完成后,broker 发送ack 之前,leader 发生故障,那么会造成数据重复。

三种机制性能依次递减,数据可靠性依次递增。

注:在 0.11 版本以前的Kafka,对此是无能为力的,只能保证数据不丢失,再在下游消费者对数据做全局去重。在 0.11 及以后版本的 Kafka,引入了一项重大特性:幂等性。所谓的幂等性就是指 Producer 不论向 Server 发送多少次重复数据, Server 端都只会持久化一条。

Filebeat+Kafka+ELK

确保node1 上有安装apache服务来产生日志

环境准备

node1:192.168.67.11 elasticsearch kibana node2:192.168.67.12 elasticsearch apache:192.168.67.10 logstash apache/nginx/mysql Filebeat节点:filebeat/192.168.67.13 Filebeat zk-kfk01:192.168.67.21 zookeeper、kafka zk-kfk02:192.168.67.22 zookeeper、kafka zk-kfk03:192.168.67.23 zookeeper、kafka systemctl stop firewalld systemctl enable firewalld setenforce 0

1、部署 Zookeeper+Kafka 集群

重启服务

systemctl restart elasticsearch.service netstat -antp | grep 9200 cd /usr/local/src/elasticsearch-head/ npm run start &

2、部署 Filebeat

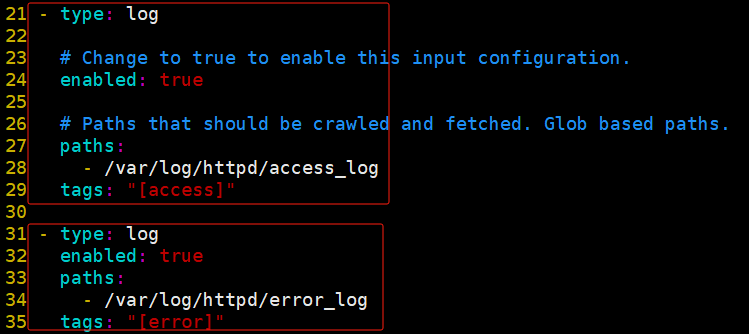

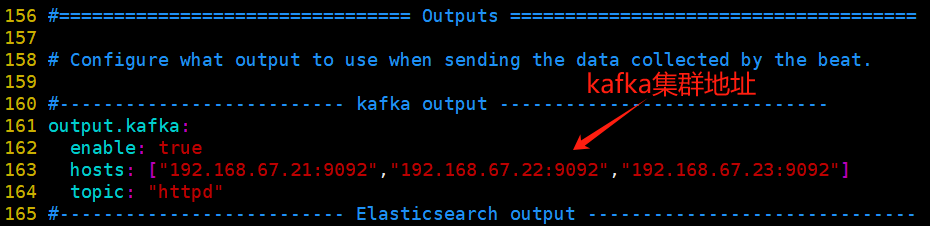

cd /etc/filebeat #cd /usr/local/filebeat vim filebeat.yml filebeat.prospectors: - type: log enabled: true paths: - /var/log/httpd/access_log tags: ["access"] - type: log enabled: true paths: - /var/log/httpd/error_log tags: ["error"] ...... #添加输出到 Kafka 的配置 output.kafka: enabled: true #指定 Kafka 集群配置 hosts: ["192.168.67.21:9092","192.168.67.22:9092","192.168.67.23:9092"] #指定 Kafka 的 topic topic: "httpd"

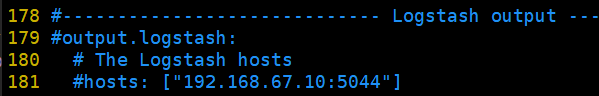

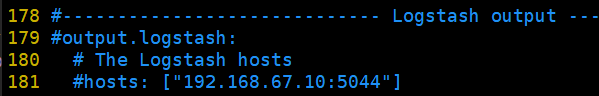

注释掉logstash出口,留下kafka出口;出口只能有一个

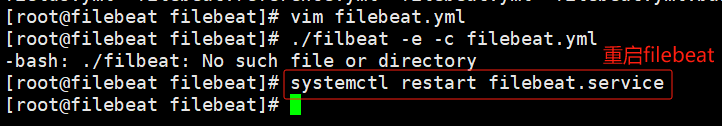

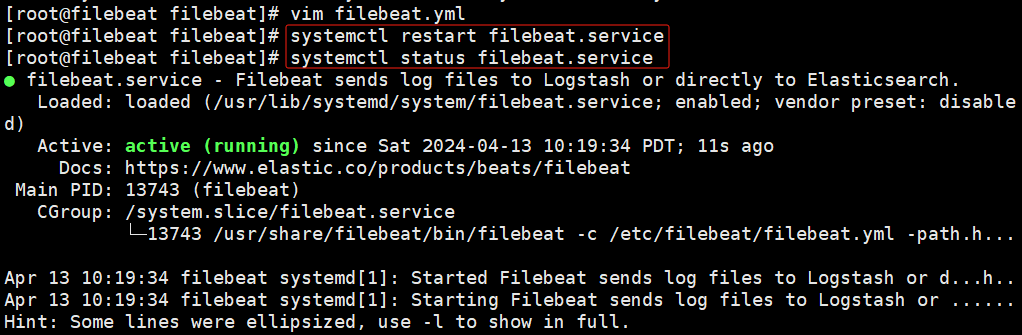

启动 filebeat

systemctl restart filebeat.service systemctl status filebeat.service # ./filebeat -e -c filebeat.yml

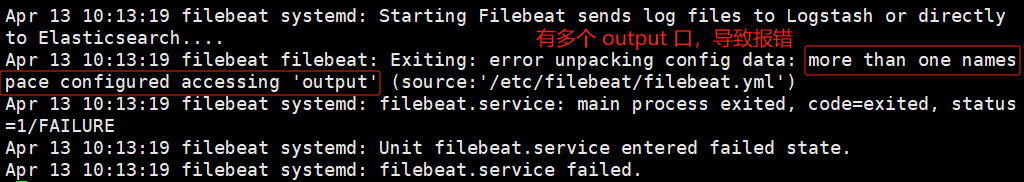

报错:服务起不来;查看日志;

原因:是filebeat.yml中将日志同时输出到了kafka和logstash

解决:注释掉logstash即可

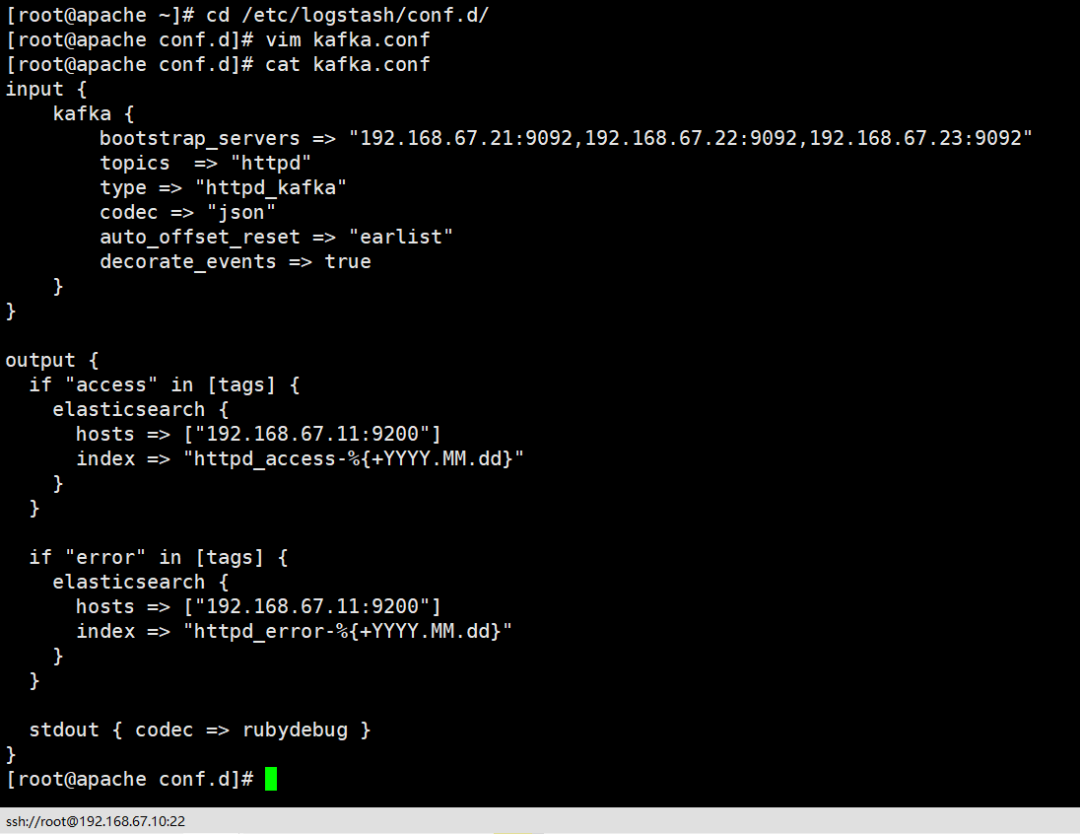

3、部署 ELK,在 Logstash 组件所在节点上新建一个 Logstash 配置文件

cd /etc/logstash/conf.d/

vim kafka.conf

input {

kafka {

#kafka集群地址

bootstrap_servers => "192.168.67.21:9092,192.168.67.22:9092,192.168.67.23:9092"

#拉取的kafka的指定topic

topics => "httpd"

#指定 type 字段

type => "httpd_kafka"

#解析json格式的日志数据

codec => "json"

#拉取最近数据,earliest为从头开始拉取

auto_offset_reset => "latest"

#传递给elasticsearch的数据额外增加kafka的属性数据

decorate_events => true

}

}

output {

if "access" in [tags] {

elasticsearch {

hosts => ["192.168.67.11:9200"]

index => "httpd_access-%{+YYYY.MM.dd}"

}

}

if "error" in [tags] {

elasticsearch {

hosts => ["192.168.67.11:9200"]

index => "httpd_error-%{+YYYY.MM.dd}"

}

}

stdout { codec => rubydebug }

}

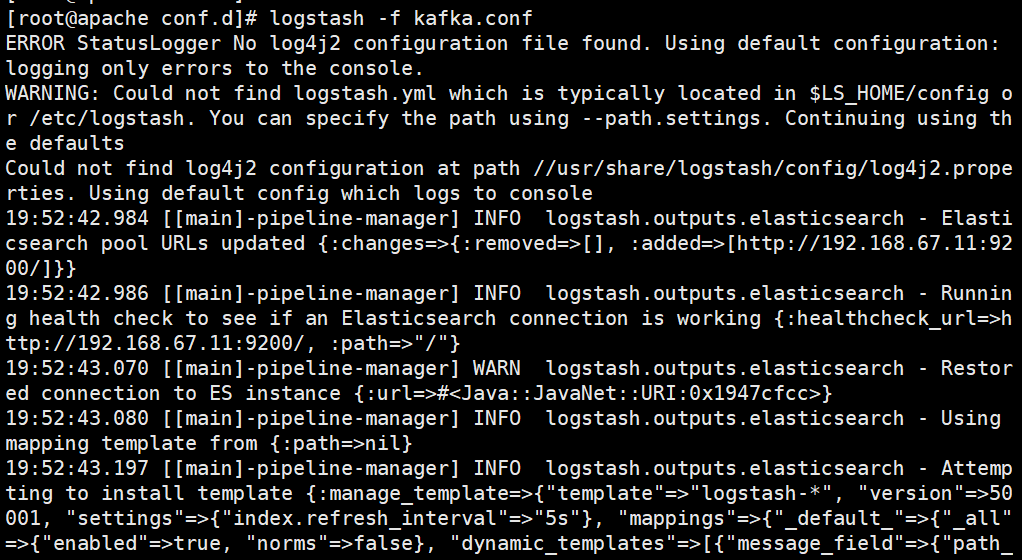

启动 logstash

`logstash -f kafka.conf`

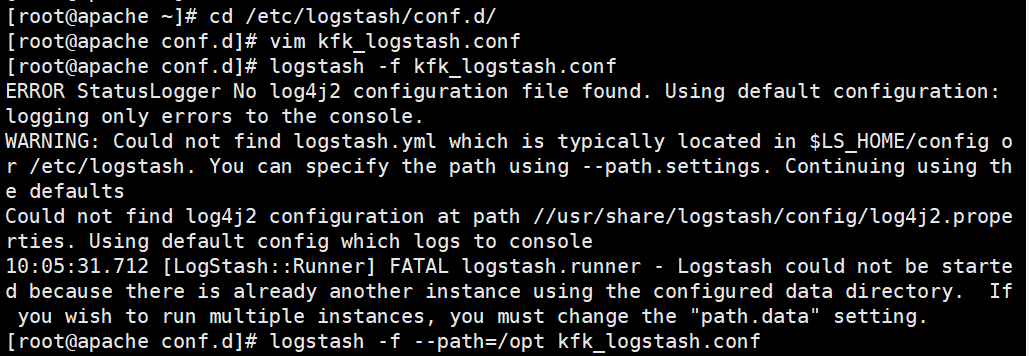

报错:路径重复

解决:指定一个新的路径

`logstash -f kafka.conf --path.data=/opt`

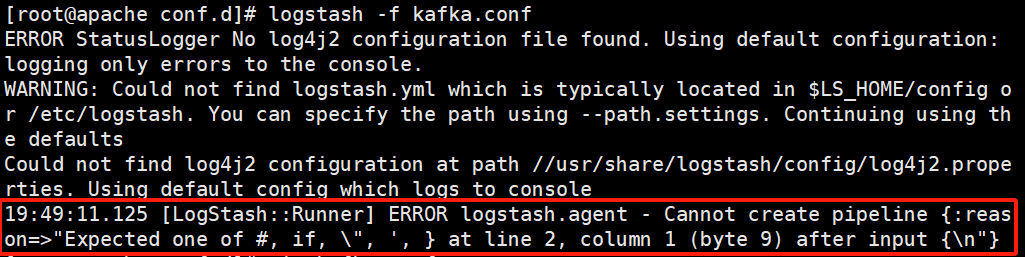

报错:配置文件有错

解决:配置文件删了重写

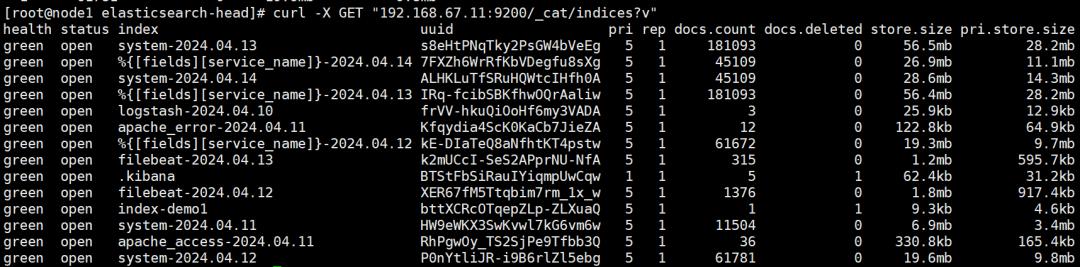

注:生产黑屏操作es时查看所有的索引:

`curl -XGET"192.168.67.11:9200/_cat/indices?v"`

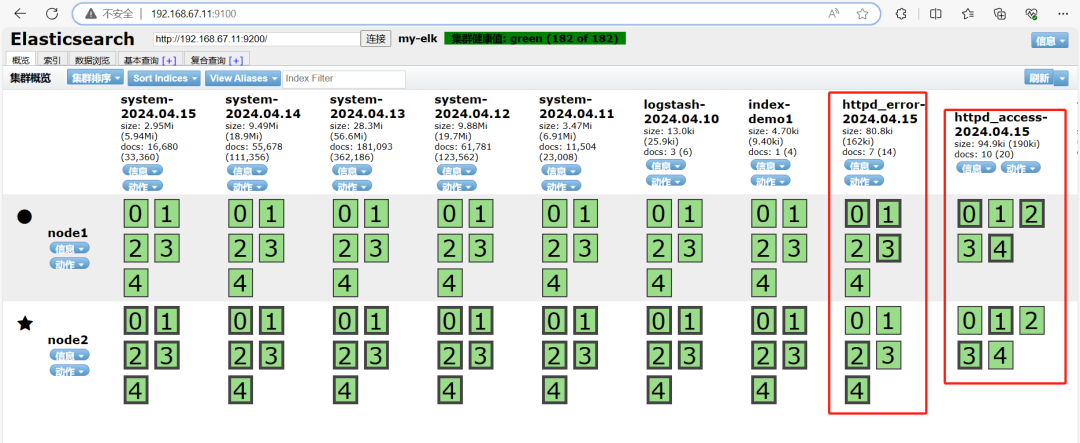

4、浏览器访问

`http://192.168.67.11:9100`

`http://192.168.67.11:5601/`

访问一下apache再访问9100

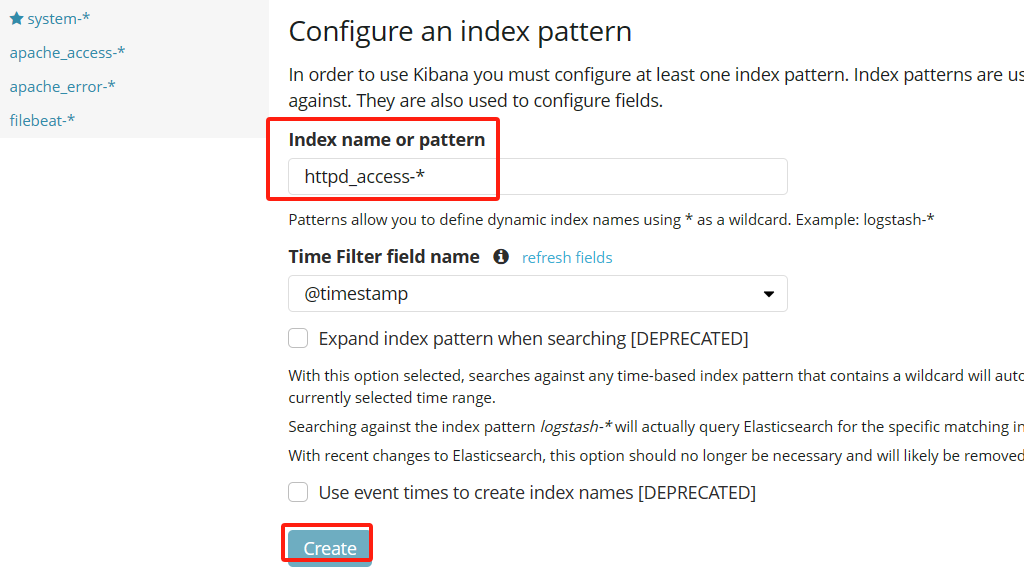

浏览器访问 http://192.168.67.11:5601 登录 Kibana,单击“Create Index Pattern”按钮添加索引“httpd_access-*”,单击 “create” 按钮创建,单击 “Discover” 按钮可查看图表信息及日志信息。

链接:https://blog.csdn.net/Mo_nor/article/details/137711958?spm=1001.2014.3001.5502

-

数据

+关注

关注

8文章

7261浏览量

92231 -

文件存储

+关注

关注

0文章

17浏览量

10714 -

kafka

+关注

关注

0文章

54浏览量

5415

原文标题:【Kafka】深度解析:高吞吐、低延迟背后的架构奥秘?

文章出处:【微信号:magedu-Linux,微信公众号:马哥Linux运维】欢迎添加关注!文章转载请注明出处。

发布评论请先 登录

电气CAD文件中高效的工作流程

Kafka存储机制详解

SIwave 3.0 工作流程简介

略谈kafka的存储机制

工作流程图怎么用?有哪些绘制工作流程图的软件

Kafka框架的工作原理及工作流程

虹科方案|使用 HK-TRUENAS支持媒体和娱乐工作流程-2

NX CAD软件:数字化工作流程解决方案(CAD工作流程)

Kafka工作流程及文件存储机制

Kafka工作流程及文件存储机制

评论